Technocratie is niet het probleem. Maar hoe we ermee omgaan wél.

We zitten midden in een digitale revolutie. Belastingdiensten, banken, overheden, zoekmachines, zelfs datingapps – allemaal nemen ze beslissingen op basis van algoritmes, data en voorspellingen. We automatiseren, standaardiseren en optimaliseren. En eerlijk is eerlijk: ik geloof dat technologie ons leven beter kan maken. Efficiënter. Rechtvaardiger zelfs. Maar dan moet het systeem wel kloppen. En daar wringt het op dit moment.

Wat we nu meemaken is niet de perfect uitgevoerde technocratie van sciencefictionfilms – het is eerder de puberteit van de digitale besluitvorming. Trial and error. En de prijs die we betalen voor die fouten? Die wordt afgerekend in mensenlevens. Families die door een algoritme worden aangemerkt als ‘risico’, spaargeld dat onterecht wordt geblokkeerd, vragenlijsten die suggereren dat jouw achternaam op zich al verdacht is.

Denk aan het toeslagenschandaal in Nederland, waar migratieachtergrond als risicofactor werd gecodeerd. Of recenter: de excuses van ING, die toegaf klanten met een migratieachtergrond extra vragen te stellen bij het openen van een rekening. Geen kwade wil, zo wordt gezegd. Maar ergens heeft iemand ooit gedacht: “Wat als geld naar het buitenland sturen een risico-indicator is?” Zonder de context te kennen. Zonder te beseffen dat het in sommige culturen juist een normaal en sociaal gebaar is.

Dit zijn menselijke aannames die via technologie schaalbaar zijn gemaakt. En precies dáár zit het gevaar.

De AI die naar je terugkijkt

Neem Elon Musk’s invloed op Grok, de chatbot van X (voorheen Twitter). Waar OpenAI, Meta en anderen worstelen met het bewaken van neutraliteit, gebruikt Musk AI juist als wapen in de cultuurstrijd. Grok is ontworpen om ‘anti-woke’ te zijn. En als de eigenaar bepaalt wat het morele kompas van een AI is, dan bepaalt hij dus ook welke realiteit die AI versterkt. En dat wordt gevaarlijk als miljoenen mensen dagelijks informatie van zo’n systeem gebruiken om hun mening te vormen.

Het laat zien: technologie is niet neutraal. AI is slechts zo rechtvaardig als de mensen die haar maken.

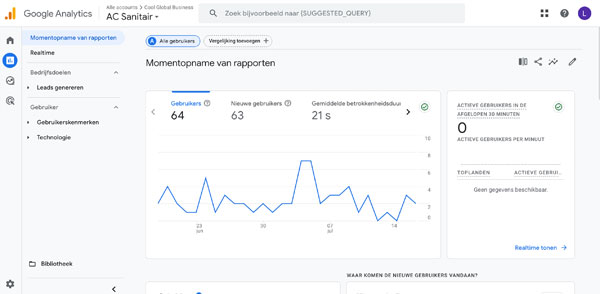

De nieuwe bureaucratie is onzichtbaar

In de klassieke bureaucratie wist je nog wie de beslissingen nam. Je kon een loket vinden, bezwaar maken, naar de rechter stappen. Maar in deze nieuwe technocratie is het systeem zelf vaak onzichtbaar. Je weet niet waarom je aanvraag is afgewezen, waarom je rekening is geblokkeerd, waarom jij eruit gepikt werd voor extra controle. Het algoritme zegt het gewoon. Punt.

We zijn beland in een tijd waarin de menselijke maat achter cijfers verdwijnt, tenzij we actief kiezen om die erin te houden. De technologie zelf is niet het probleem. Het zijn de aannames, de blinde plekken, de ideologische invloeden en het gebrek aan verantwoording die het gevaarlijk maken.

Wat nu?

We staan op een kruispunt. Aan de ene kant: een toekomst waarin technologie ons rechtvaardiger en efficiënter helpt samenleven. Aan de andere kant: een pad waarin technologie – onbedoeld of bewust – onze vooroordelen versterkt, ongelijkheid vergroot en het democratisch proces uitholt.

Als we kiezen voor technocratie, dan moeten we ook kiezen voor transparantie, diversiteit en toetsing. We moeten technologie ontwerpen die zichzelf durft te bevragen. Die rechtvaardig is, ook als niemand kijkt. En vooral: die door mensen wordt bewaakt die álle mensen vertegenwoordigen – ongeacht kleur, herkomst of ideologie.

Want technocratie kan werken. Maar alleen als de mensen achter de schermen zich realiseren dat technologie niet boven de mens staat. En dat ‘efficiëntie’ nooit belangrijker mag worden dan rechtvaardigheid.